DeepSeek V4’ün gelişi, yapay zekâ modellerinde sadece “daha büyük” olmanın yeterli olmadığını bir kez daha ortaya koyuyor çünkü bu model doğrudan verimlilik ve optimizasyon üzerine kurulmuş bir yaklaşım sunuyor. Özellikle 1.6 trilyon parametreye kadar çıkan model boyutlarına rağmen, işlem yükünün ciddi şekilde azaltılmış olması dikkat çekiyor çünkü yeni mimari, klasik modellere kıyasla çok daha düşük hesaplama maliyetiyle çalışabiliyor. Tek token çıkarımında kullanılan FLOP miktarının ciddi oranda düşürülmesi ve KV cache kullanımının minimize edilmesi, sistemin hem daha hızlı hem de daha verimli çalışmasını sağlıyor.

Bu yaklaşımın en önemli sonucu ise şu oluyor: artık sadece güçlü donanım değil, o donanımı doğru kullanan model mimarisi de en az onun kadar kritik hale geliyor. DeepSeek V4 tam olarak bu noktada fark yaratıyor çünkü performansı artırırken maliyeti düşürmeyi başarıyor.

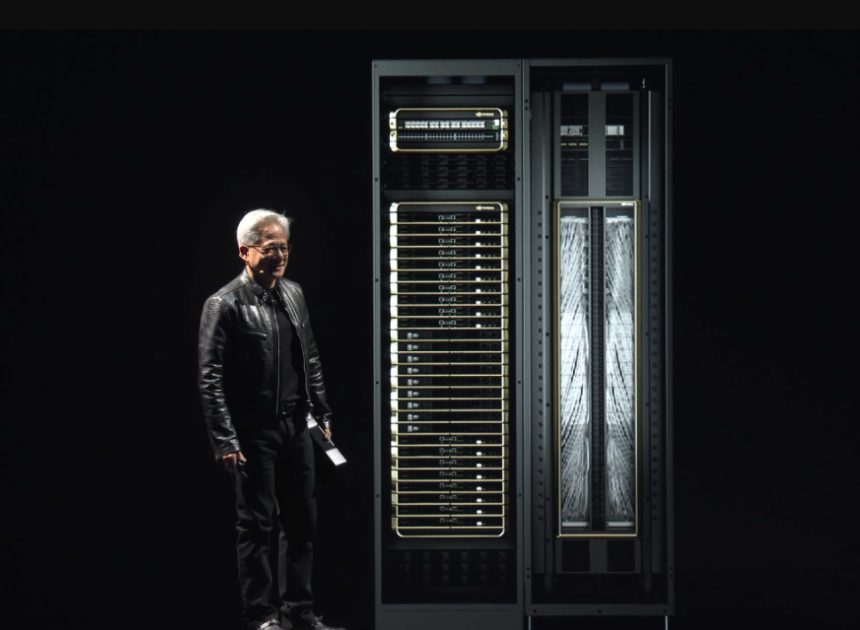

NVIDIA neden bu kadar önde başladı?

NVIDIA’nın burada yaptığı en kritik hamle, DeepSeek V4 için ilk günden hazır olması çünkü çoğu donanım üreticisi yeni modeller çıktıktan sonra uyumluluk ve optimizasyon sürecine girerken, NVIDIA doğrudan lansman anında tam destek sunmayı başardı. Bu da Blackwell GPU’ların sadece güçlü değil, aynı zamanda yeni nesil yapay zekâ modellerine özel olarak hazırlandığını gösteriyor.

Özellikle NVFP4 veri formatı ve optimize edilmiş CUDA çekirdekleri, bu modelin ihtiyaç duyduğu düşük gecikmeli ve yüksek verimli işlem gücünü sağlamak için kritik rol oynuyor. Bunun üzerine gelişmiş paralelleştirme teknikleri ve yazılım tarafındaki optimizasyonlar da eklendiğinde ortaya oldukça dengeli bir sistem çıkıyor. Bu sayede NVIDIA, sadece donanım satmak yerine doğrudan bir ekosistem sunarak rakiplerinden ayrışıyor.

3500 token/saniye ne anlama geliyor?

Verilen rakamlar kağıt üzerinde etkileyici görünebilir ancak asıl önemli olan bunun gerçek kullanımda ne ifade ettiği çünkü saniyede 3500 token işleyebilmek, özellikle büyük dil modelleri için ciddi bir hız anlamına geliyor. Bu seviyede bir performans, uzun metin analizleri, gerçek zamanlı yapay zekâ uygulamaları ve büyük ölçekli veri işleme süreçlerinde ciddi bir fark yaratabilir.

Bu performansın arkasındaki temel unsurlar şu şekilde özetlenebilir:

- NVFP4 ve FP4 tabanlı düşük hassasiyetli hesaplama teknikleri

- optimize edilmiş CUDA çekirdekleri ve paralel işlem yapısı

- gelişmiş bellek yönetimi ve düşük gecikme optimizasyonları

- model mimarisi ile donanımın birlikte optimize edilmesi

Bu kombinasyon sayesinde sadece hız değil, aynı zamanda maliyet verimliliği de sağlanıyor çünkü daha az kaynakla daha fazla iş yapılabiliyor.

Donanım rekabeti kızışıyor

DeepSeek V4 her ne kadar NVIDIA ile güçlü bir başlangıç yapmış olsa da, rekabetin tek taraflı ilerlemesi pek mümkün görünmüyor çünkü özellikle Çin tarafında geliştirilen yeni nesil yapay zekâ çipleri de bu modele uyum sağlayacak şekilde tasarlanıyor. Huawei’nin yeni Ascend serisi çiplerinde FP4 benzeri komutların yer alması, bu modelin farklı donanım platformlarında da çalışabileceğini gösteriyor.

Bu durum aslında yapay zekâ tarafında önemli bir kırılmaya işaret ediyor çünkü artık modeller belirli bir donanıma bağımlı kalmak yerine daha geniş bir ekosisteme yayılmaya başlıyor. Ancak burada NVIDIA’nın avantajı, hem donanım hem yazılım tarafını aynı anda optimize edebilmesi ve bunu erken yapabilmesi oluyor.

NVIDIA’nın DeepSeek V4 lansmanındaki pozisyonu, şirketin yapay zekâ alanında neden bu kadar dominant olduğunu bir kez daha ortaya koyuyor çünkü sadece güçlü GPU üretmek yeterli değil, aynı zamanda bu GPU’ları yeni nesil modellere hazır hale getirmek gerekiyor. Blackwell mimarisiyle gelen erken destek, NVIDIA’ya ciddi bir zaman avantajı sağlarken, DeepSeek V4’ün sunduğu verimlilik odaklı yaklaşım da yapay zekâ dünyasında yeni bir standart oluşturabilir. Eğer bu optimizasyonlar yaygınlaşırsa, önümüzdeki dönemde daha hızlı, daha ucuz ve daha erişilebilir yapay zekâ sistemleri görmek oldukça mümkün hale gelebilir.

Henüz hiç yorum yapılmamış. İlk yorumu sen yap!

Henüz hiç yorum yapılmamış. İlk yorumu sen yap!